AI

312 Inhalte

Entdecken Sie unser Archiv zu tiefgehenden Inhalte zum Thema AI.

Mit Hardwarebeschleunigern für HPC- und KI-Systeme wird das Programmieren in Zukunftimmer paralleler werden. Spannende Zeiten für Entwickler, die heute mit C++ arbeiten. Eine der grundlegenden Neuerungen, die oneAPI für sie bringt, ist das Programmiermodell Data Parallel C++, kurz DPC++. Dabei handelt es sich um ein modernes, paralleles C++ für heterogene Architekturen. Die Basis bildet Khronos SY..

Die Antwort ist simpel: Das gehypte Sprachmodell, das Entwickler von OpenAI im Sommer präsentierten, funktioniert verblüffend gut, ist aber völlig dumm. Neuronale Sprachmodelle wie der Generative Pretrained Transformer 3 (GPT-3) arbeiten wie das Auto-Complete eines sehr alten Nokia-Handys: Nach Eingabe weniger Worte versucht die Software, das nächste Wort mathematisch möglichst gut vorherzusagen. ..

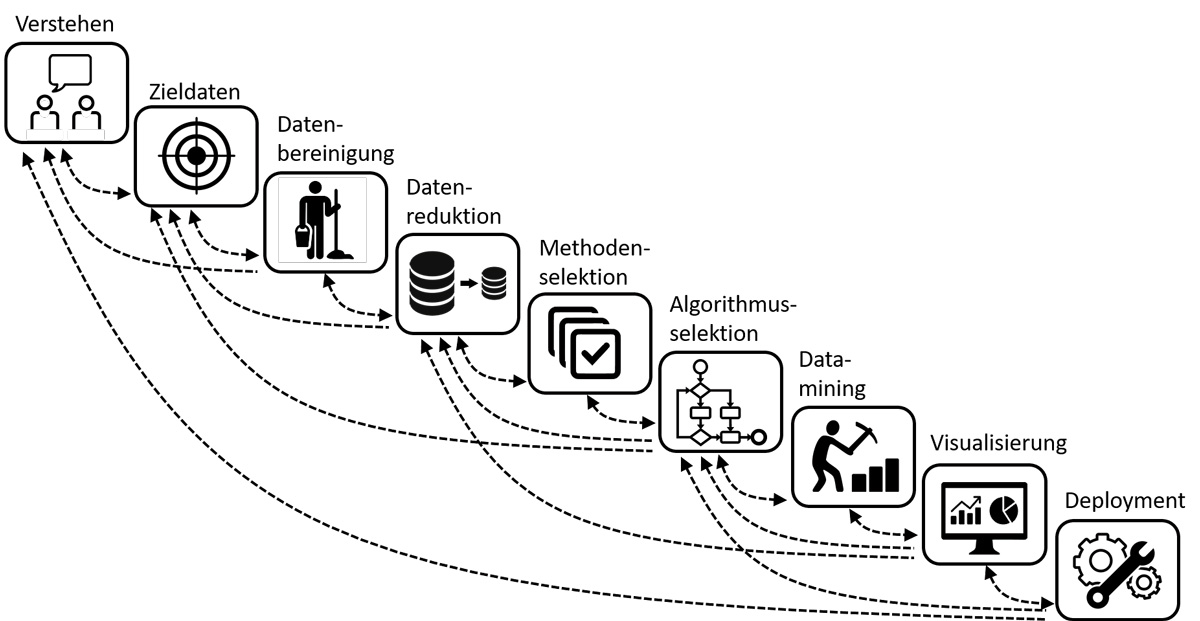

Der Einsatz von Maschinellem Lernen (ML) im Umfeld von Supply-ChainManagement und Logistik ist vor dem Hintergrund von Industrie 4.0 und Smart Factory von sehr großer Bedeutung. In nahezu allen Phasen der Logistik von Beschaffung, Produktion und Distribution über Planung und Gestaltung bis hin zur Ausführung und zum Qualitätsmanagement in Echtzeit können diese KI-Methoden zum Einsatz kommen.

Es ist so weit – nach vielen Jahren endet mit dem Jahr 2020 die Ära von Intel Parallel Studio XE. Aber keine Angst, die oneAPI Tookits bieten als Nachfolger genau die gleichen Komponenten, Compiler, Bibliotheken und Analyse-Tools. Doch es steckt viel mehr drin. Der Artikel zeigt auf, wie Umsteiger am besten von diesem Mehrwert profitieren können.

Amazon, Google, Microsoft, Oracle, Salesforce oder SAP bewegen den digitalen Hub mit Riesenschritten in die Cloud. Aber was bedeutet das für Ihren Job in der Software-QS? Sie müssen immer früher, schneller und aufwendiger testen. Die Anforderungen steigen permanent. Dafür gibt es jetzt eine Lösung: Robotic Testautomation aus der Cloud. Hier sind fünf Gründe, warum Sie Ihren persönlichen Test-Bot a..